Retningslinjer for bruk av kunstig intelligens i styrearbeidet

Kunstig intelligens gir styrer muligheter for dypere analyser og mer effektivt arbeid, men teknologien bringer også med seg nye krav til sikkerhet og ansvar. Denne veilederen gir deg innsikten styret trenger for å navigere i AI-landskapet, inkludert konkrete råd om konfidensialitet, risiko og en ferdig mal for formelle retningslinjer.

Hvorfor AI angår styret

Kunstig intelligens (forkortet KI eller AI, heretter kalt AI) er i ferd med å bli et viktig verktøy i kunnskapsarbeid. Teknologien kan bidra til mer effektiv informasjonsbehandling, grundigere analyser og bedre beslutningsgrunnlag i styrearbeidet. Samtidig reiser bruk av AI spørsmål knyttet til konfidensialitet, personvern, informasjonssikkerhet og kvaliteten på vurderingene som ligger til grunn for beslutningene.

Utviklingen de siste årene har gått raskt. Der mange virksomheter tidligere først og fremst var opptatt av risikoen ved å ta i bruk AI, er oppmerksomheten nå i større grad rettet mot hvordan teknologien kan brukes på en forsvarlig og verdiskapende måte. Dette gjelder både i offentlig sektor og i næringslivet, og understreker behovet for tydelige rammer også i styrearbeidet.

Digitaliserings- og forvaltningsminister Karianne Tung har uttalt:

"Jeg blir ofte spurt om hva som er min største bekymring knyttet til kunstig intelligens. Svaret mitt er ganske enkelt: Jeg er mest bekymret for at det ikke blir tatt i bruk."

Uttalelsen illustrerer at utfordringen i dag ikke bare handler om risikoen ved å bruke AI, men også om risikoen ved å la være. Styret har et overordnet ansvar for at virksomheten forvaltes på en god og forsvarlig måte. Dette innebærer også at styret må forholde seg aktivt til teknologiutviklingen og vurdere hvordan nye verktøy, som kunstig intelligens, kan påvirke virksomhetens risiko, muligheter og konkurranseevne.

Et styre som ikke evner å følge utviklingen, kan over tid få et svakere beslutningsgrunnlag og redusert evne til å ivareta sitt ansvar. Styret bør derfor holde seg oppdatert på utviklingen innen kunstig intelligens og bidra til at virksomheten har et bevisst og ansvarlig forhold til teknologien. For mange styrer vil det også være naturlig å vurdere hvordan teknologien kan brukes som støtte i eget arbeid. Dette gjelder særlig i lys av nytt regelverk knyttet til kunstig intelligens, som forsterker behovet for kontroll, risikovurdering og ansvarlig bruk av teknologien.

AI-forordningen og ny AI-lov

EU har vedtatt et nytt regelverk for kunstig intelligens (AI-forordningen), som også gjennomføres i norsk rett gjennom en egen AI-lov. Regelverket retter seg i hovedsak mot leverandører og utviklere av AI-systemer, ikke mot ordinær bruk av AI i virksomheter. Likevel understreker regelverket betydningen av ansvarlig bruk, kontroll over data og menneskelig ansvar for beslutninger. Styret bør derfor ha et bevisst forhold til hvordan AI brukes i styrearbeidet.

Regelverket bygger på en risikobasert tilnærming. Jo større risiko et AI-system kan innebære for sikkerhet, personvern eller grunnleggende rettigheter, desto strengere krav gjelder. For vanlig bruk av AI som støtte i styrearbeidet vil risikoen normalt være begrenset, men ansvarlig bruk og kontroll over informasjon er likevel viktig.

Mange styrer mangler retningslinjer for bruk av AI

Undersøkelser gjennomført av Norges Handelshøyskole (NHH) og Orgbrain i 2026 blant norske styrer viser at få styrer har klare retningslinjer for bruk av AI i styrearbeidet. På spørsmålet om hvilke retningslinjer selskapet eller organisasjonen har for bruk av AI i styrearbeidet, svarte deltakerne:

- 57 %: Det finnes ingen formelle retningslinjer eller reguleringer

- 27 %: Bruken er diskutert, men ikke formalisert i retningslinjer

- 14 %: Det finnes klare retningslinjer som regulerer bruken

- 1 %: Det er ikke tillatt å bruke AI-verktøy

- 4 %: Vet ikke

Resultatene tyder på at mange styrer mangler et tydelig rammeverk for bruk av AI. Det kan skape usikkerhet om hva som er forsvarlig bruk. Klare prinsipper og retningslinjer bidrar derfor til tryggere og mer effektiv bruk av AI i styrets arbeid.

Denne veilederen gir en kort innføring i sentrale problemstillinger knyttet til bruk av AI i styrearbeid og avsluttes med en mal for retningslinjer som kan brukes direkte eller tilpasses egne behov.

To sentrale risikoområder ved bruk av AI i styrearbeidet

Når AI brukes i styrearbeidet, er det særlig to typer risiko det er viktig å være oppmerksom på:

- Deling av konfidensiell informasjon: Bruk av AI kan innebære risiko for at konfidensiell, sensitiv eller annen beskyttelsesverdig informasjon deles med eksterne tjenester uten tilstrekkelig kontroll.

- Ukritisk bruk av AI-generert innhold: AI kan generere analyser, vurderinger og formuleringer som fremstår overbevisende, men som kan være feil, mangelfulle eller bygge på svake forutsetninger.

AI bør derfor brukes som et støtteverktøy i styrearbeidet, ikke som en erstatning for styrets egne vurderinger og ansvar.

Datadeling og AI-tjenester

De fleste virksomheter deler allerede i dag informasjon med eksterne teknologileverandører. Skytjenester fra Microsoft eller Google benyttes til e-post, dokumenthåndtering og samhandling. I slike løsninger er det normalt inngått databehandleravtaler som regulerer hvordan data behandles, lagres og beskyttes. Det er også vanlig at virksomhetens data ikke brukes til trening eller videreutvikling av leverandørens tjenester.

Ved bruk av åpne AI-tjenester kan situasjonen være annerledes. Når tekst legges inn i slike tjenester, sendes informasjonen til leverandørens systemer for behandling. Avhengig av tjeneste, avtale og innstillinger kan data lagres eller brukes til å forbedre modellen. Dette innebærer en betydelig risiko for at konfidensiell informasjon kommer på avveie.

Flere leverandører tilbyr imidlertid AI-løsninger gjennom bedriftsavtaler eller kontrollerte plattformer. I slike løsninger kan virksomheten inngå databehandleravtaler, stille krav til hvor data behandles og sikre at informasjon ikke brukes til trening av modellen.

I praksis betyr dette at virksomheter bør ha et bevisst forhold til hvilke AI-løsninger som brukes i styrearbeid og hvilke typer informasjon som kan deles i ulike verktøy.

Vurdering av AI-verktøy før bruk i styrearbeid

Før et AI-verktøy tas i bruk i styrearbeid eller til behandling av styremateriale, bør virksomheten foreta en enkel vurdering av sentrale forhold knyttet til informasjonssikkerhet, personvern og databehandling.

Følgende spørsmål bør som minimum vurderes:

- Databehandleravtale: Finnes det en tydelig databehandleravtale eller tilsvarende regulering av hvordan leverandøren håndterer data?

- Bruk av data til modelltrening: Brukes informasjon som legges inn i tjenesten til å trene leverandørens modeller, eller holdes kundedata atskilt?

- Lagring og geografisk behandling av data: Hvor lagres data, og i hvilke land behandles informasjonen? Er dette i samsvar med virksomhetens krav til personvern og informasjonssikkerhet?

- Tilgangsstyring: Kan tilgangen til verktøyet styres gjennom virksomhetens egne brukerkontroller, for eksempel rollebasert tilgang eller integrasjon med eksisterende identitetsløsninger?

- Logging og sporbarhet: Er det mulig å logge eller dokumentere bruken av verktøyet, slik at virksomheten kan etterprøve hvordan informasjonen er behandlet?

- Sletting og datakontroll: Har virksomheten kontroll over sletting av data, og finnes det tydelige rutiner for hvor lenge informasjon lagres?

En slik vurdering trenger ikke være omfattende, men bør sikre at virksomheten har et bevisst forhold til hvordan informasjon håndteres før verktøyet tas i bruk i styrearbeid eller til behandling av styremateriale.

Strengere krav for virksomheter med høy risiko

Virksomheter med særlig høy risiko, for eksempel børsnoterte selskaper eller virksomheter med strenge regulatoriske krav, bør vurdere strengere retningslinjer. Dette kan blant annet innebære mer begrenset bruk av åpne AI-tjenester og tydeligere krav til bruk av godkjente løsninger.

En særlig praktisk risiko oppstår når styremedlemmer eller andre deltakere i styrearbeidet bruker private AI-kontoer, private abonnementer eller egne enheter til å analysere styrepapirer, fordi dette oppleves som enkelt og tilgjengelig. I slike tilfeller kan virksomheten miste kontroll over hvor informasjonen behandles, hvilke avtalevilkår som gjelder, og om data lagres eller brukes videre av tjenesteleverandøren. Dokumenter og informasjon fra styrearbeidet som inneholder konfidensiell, sensitiv eller på annen måte beskyttelsesverdig informasjon, bør derfor ikke behandles i private AI-kontoer eller i løsninger som ikke er godkjent av virksomheten.

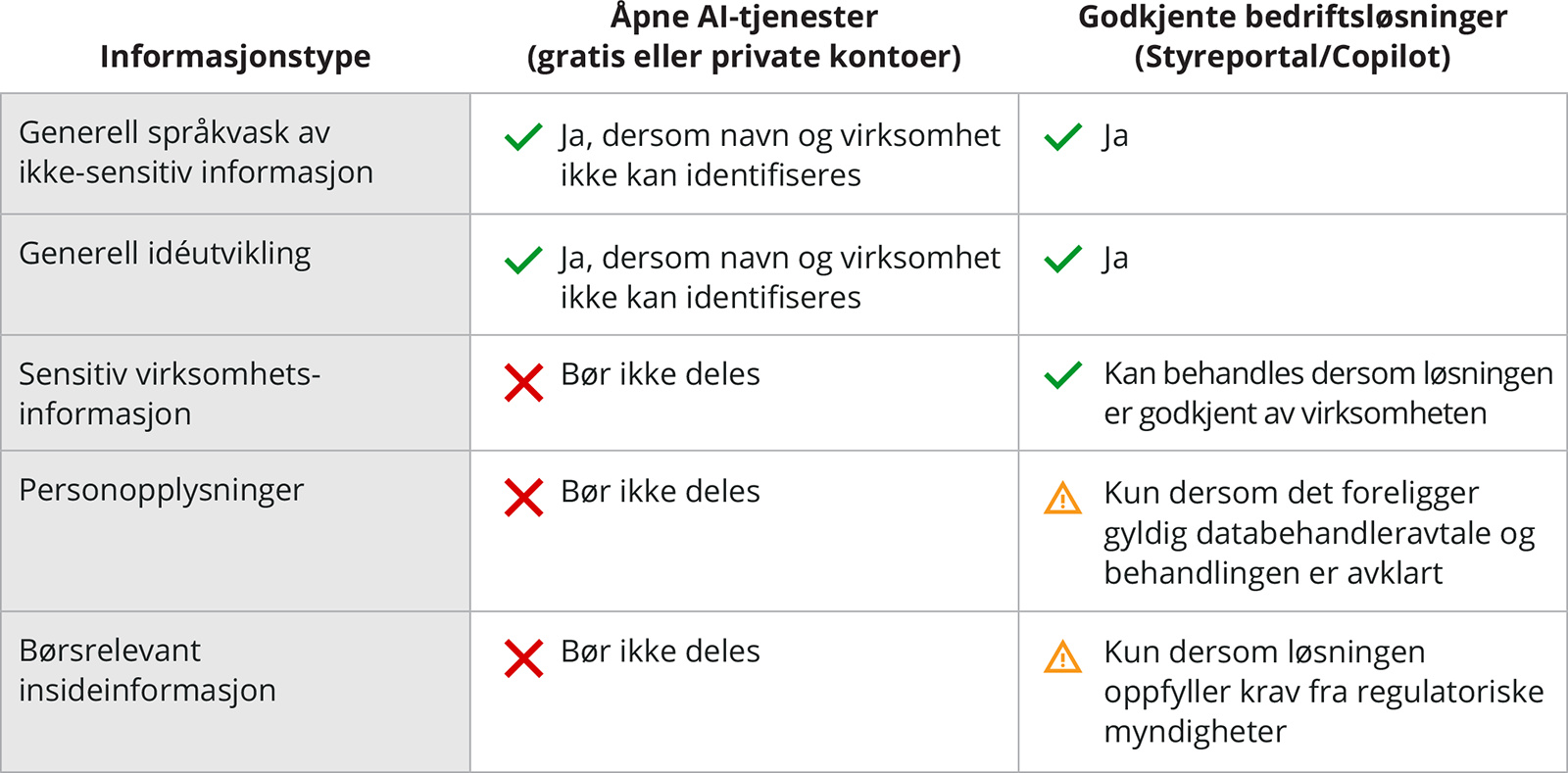

Tabellen nedenfor viser forenklede eksempler på hvordan ulike typer informasjon kan vurderes ved bruk av åpne AI-tjenester og godkjente bedriftsløsninger. Den må ses i lys av virksomhetens egne retningslinjer og risikoprofil.

Tabellen illustrerer noen praktiske vurderinger ved bruk av AI i styrearbeid, særlig knyttet til håndtering av konfidensiell informasjon.

Hvordan AI kan støtte styrearbeid

Brukt riktig kan AI bidra til å styrke styrearbeidet på flere områder. Teknologien kan blant annet bidra til:

- bedre forberedelser til styremøter

- raskere oppsummering av omfattende dokumenter og rapporter

- identifisering av sentrale problemstillinger i styrematerialet

- formulering av relevante og kritiske spørsmål til ledelsen

- strukturering av analyser og egne notater

- forklaring av komplekse faglige, juridiske eller finansielle temaer

- identifisering av risikoer og muligheter i saker som behandles av styret

- analyse av utviklingstrekk i marked, bransje eller rammebetingelser

- vurdering av alternative perspektiver eller mulige konsekvenser av beslutninger

- identifisering av oppgaver, beslutninger og risikoer i møtediskusjoner

- utkast til referat eller protokoll

Forskning tyder også på at AI kan bidra til mer struktur i diskusjoner og bedre utnyttelse av styrematerialet, blant annet ved å identifisere sentrale problemstillinger, mulige risikoer og relevante spørsmål til ledelsen.

Målet er ikke å automatisere styrets arbeid, men å gi styremedlemmer bedre støtte i forberedelser, analyse og refleksjon.

Styret bør i tillegg ha et bevisst forhold til hvordan AI brukes i virksomheten generelt og ikke bare i selve styrearbeidet. Det kan være hensiktsmessig at styret jevnlig etterspør en oversikt fra ledelsen over hvilke AI-verktøy som brukes i organisasjonen, hvilke vurderinger som er gjort knyttet til personvern, sikkerhet og risiko.

Les også: Møte-AI: protokoll og møteanalyse på minutter

MAL: Retningslinjer for bruk av kunstig intelligens i styrearbeidet

For å sikre en trygg og kontrollert bruk av AI i styrearbeidet bør styret ha tydelige retningslinjer. Vi har derfor laget en en mal til retningslinjer som kan vedtas av styret direkte eller tilpasses virksomhetens risikoprofil, bransje og valg av verktøy.

Styret bør som minimum avklare hvilke AI-verktøy som er godkjent for bruk i styrearbeidet, og hvilke typer informasjon som kan deles i ulike verktøy. Når retningslinjene er vedtatt, bør de inngå i styrets interne styringsdokumenter og gjennomgås ved styrebytte og minst én gang per år.

Malen er generell og kan brukes av mange virksomheter. Virksomheter med særlig høy risiko, for eksempel børsnoterte selskaper eller virksomheter med strenge regulatoriske krav, bør vurdere strengere og mer detaljerte retningslinjer.

Ofte stilte spørsmål om bruk av AI i styrearbeid

Ja, AI-verktøy kan være nyttige som støtte i styrearbeidet, for eksempel til å oppsummere dokumenter, strukturere analyser eller formulere spørsmål til ledelsen. Det er imidlertid viktig at konfidensiell informasjon, personopplysninger eller sensitive styrepapirer ikke legges inn i åpne AI-tjenester.

Ja. Det finnes ingen generelle regler som forbyr bruk av AI i styrearbeid. Styret må likevel sikre at bruken skjer på en forsvarlig måte, særlig når det gjelder informasjonssikkerhet, personvern og kvaliteten på beslutningsgrunnlaget.

Nei. AI kan være et nyttig analyseverktøy, men kan ikke erstatte styrets ansvar for vurderinger og beslutninger. Styret har alltid ansvar for beslutningsgrunnlaget og konsekvensene av beslutningene som tas.

AI kan blant annet brukes til å:

-

oppsummere omfattende styremateriale

-

identifisere sentrale problemstillinger i en sak

-

formulere spørsmål til ledelsen

-

strukturere analyser og notater

-

forklare komplekse juridiske eller finansielle temaer

Dette kan bidra til bedre forberedelser og mer effektive styremøter.

Styret bør blant annet sikre at virksomheten har:

-

oversikt over hvilke AI-verktøy som brukes i organisasjonen

-

retningslinjer for håndtering av konfidensiell informasjon ved bruk av AI

-

vurderinger av risiko knyttet til personvern og informasjonssikkerhet

-

tilstrekkelig kompetanse om bruk av teknologien

De to viktigste risikoene er deling av konfidensiell informasjon og ukritisk bruk av AI-genererte analyser. AI kan formulere svar som fremstår overbevisende, men som kan være feil eller mangelfulle.

Ja, mange virksomheter velger å etablere enkle retningslinjer som avklarer hvilke AI-verktøy som kan brukes i styrearbeidet, og hvilken type informasjon som kan deles i ulike verktøy.

Ja. I denne artikkelen kan du laste ned en praktisk mal for retningslinjer for bruk av kunstig intelligens i styrearbeid, som kan vedtas direkte av styret eller tilpasses virksomhetens behov.

Du vil kanskje også like

Disse relaterte artiklene

Valg av styreportal – en praktisk veileder

AI i styrerommet: hva forskning og praksis faktisk viser

.webp?width=1920&height=1080&name=Styremedlem%20%E2%80%93%20du%20er%20saks%C3%B8kt%20(og%20dette%20b%C3%B8r%20du%20gj%C3%B8re).webp)